¿Quién controla la realidad? La Inteligencia Artificial Generativa está redibujando los límites de lo posible, creando mundos virtuales tan realistas que es difícil distinguirlos de los nuestros. Pero, ¿qué sucede cuando esta tecnología cae en las manos equivocadas?

A continuación, nos sumergiremos en un mundo donde la verdad se vuelve elástica y la línea entre lo real y lo ficticio se desvanece. La era de la desinformación ha llegado. La IAG está amplificando el problema, generando contenidos falsos a una velocidad vertiginosa. ¿Quieres saber cómo protegerte de esta amenaza? ¡Sigue leyendo!

En la era digital, la IA generativa ha emergido como una herramienta poderosa capaz de crear contenido original, desde textos y música hasta imágenes y videos. Sin embargo, con este poder viene una serie de preguntas éticas y de control: ¿Quién controla la narrativa? ¿Cómo se maneja el poder de la IA generativa? ¿Qué papel juega la censura en este nuevo panorama?

La revolución silenciosa

La IA generativa está transformando la forma en que creamos y consumimos información. Desde obras de arte hasta noticias, la IAG está generando contenidos cada vez más sofisticados y realistas. Pero, ¿qué implica este poder creativo en nuestras manos? ¿Quién controla las historias que se cuentan? ¿Y cómo garantizamos que estas tecnologías se utilicen de forma ética y responsable?

La narrativa es el tejido de nuestra realidad. Las historias que escuchamos, leemos y vemos moldean nuestra percepción del mundo, influyen en nuestras decisiones y construyen nuestra identidad colectiva. Sin embargo, la IAG se ha convertido en un poderoso narrador, capaz de generar contenidos a gran escala y con una velocidad inimaginable. Por ejemplo:

- Desinformación a gran escala: La facilidad con la que se pueden crear contenidos falsos o engañosos plantea un serio desafío a la verdad y a la democracia.

- Sesgos algorítmicos: Los modelos de IAG aprenden de los datos con los que son entrenados, lo que significa que pueden perpetuar y amplificar los sesgos existentes en la sociedad.

- Manipulación de la opinión pública: La IAG puede utilizarse para crear campañas de desinformación a gran escala, con el objetivo de influir en elecciones o manipular la opinión pública.

Con este poder viene una gran responsabilidad. Es crucial que los desarrolladores, las empresas y los gobiernos trabajen juntos para garantizar que la IA se utilice de manera ética y responsable, protegiendo la libertad de expresión y evitando la desinformación y la manipulación.

El Poder de la IA Generativa

La IA generativa, como GPT-4 y otros modelos avanzados, tiene la capacidad de generar contenido que puede influir en la opinión pública, moldear narrativas y hasta crear realidades alternativas. Este poder puede ser utilizado para el bien, como en la creación de contenido educativo y creativo, pero también puede ser mal utilizado para desinformar y manipular.

Ejemplo de Generación de texto con GPT-4

from transformers import GPT2LMHeadModel, GPT2Tokenizer

# Cargar el modelo y el tokenizador

model_name = 'gpt2'

model = GPT2LMHeadModel.from_pretrained(model_name)

tokenizer = GPT2Tokenizer.from_pretrained(model_name)

# Texto de entrada

input_text = "La inteligencia artificial generativa es"

# Tokenizar el texto de entrada

input_ids = tokenizer.encode(input_text, return_tensors='pt')

# Generar texto

output = model.generate(input_ids, max_length=50, num_return_sequences=1)

# Decodificar y mostrar el texto generado

generated_text = tokenizer.decode(output[0], skip_special_tokens=True)

print(generated_text)Lenguaje del código: PHP (php)El ejemplo anterior, utiliza el modelo GPT-2 y su tokenizador para procesar y generar texto. Primero, define el texto inicial que se desea completar, en este caso, “La inteligencia artificial generativa es”, y lo convierte en una secuencia de tokens (números) que el modelo puede entender.

Luego, el modelo GPT-2 genera una continuación del texto de entrada, con una longitud máxima de 50 tokens. Finalmente, convierte los tokens generados de vuelta a texto legible y muestra el texto generado en la consola. En resumen, este código toma una frase inicial y utiliza el modelo GPT-2 para generar una continuación de esa frase.

Ética, responsabilidad y la IA Generativa

Ante este escenario, es fundamental desarrollar un marco ético para el desarrollo y uso de la IAG. Algunas de las preguntas clave que debemos plantearnos son:

- ¿Quién es responsable del contenido generado por la IAG? ¿El creador del modelo, el usuario o la plataforma?

- ¿Cómo podemos garantizar la transparencia y la trazabilidad de los contenidos generados por la IAG?

- ¿Qué medidas podemos tomar para evitar que la IAG se utilice para fines maliciosos?

La ética en la IAG es un tema muy complejo. Por consiguiente, tanto los desarrolladores como las empresas que crean estas tecnologías, tienen la responsabilidad de asegurarse de que sus creaciones no sean utilizadas para propósitos dañinos. Esto incluye la implementación de medidas para evitar la generación de contenido ofensivo, discriminatorio o falso.

Ejemplo de Filtrado de contenido ofensivo

def filter_offensive_content(text):

offensive_words = ["palabra_ofensiva1", "palabra_ofensiva2"]

for word in offensive_words:

if word in text:

return True

return False

# Texto generado

generated_text = "Este es un ejemplo de texto generado con IA."

# Filtrar contenido ofensivo

if filter_offensive_content(generated_text):

print("El texto contiene contenido ofensivo.")

else:

print("El texto es seguro.")Lenguaje del código: PHP (php)¿Qué hace este código?

- Definición de la función: La función

filter_offensive_contenttoma un texto como entrada y verifica si contiene palabras ofensivas. - Lista de palabras ofensivas: Se define una lista llamada

offensive_wordsque contiene palabras que se consideran ofensivas. - Búsqueda de palabras ofensivas: La función recorre cada palabra en la lista

offensive_wordsy verifica si alguna de ellas está presente en el texto de entrada. - Retorno de resultado: Si se encuentra una palabra ofensiva en el texto, la función devuelve

True. Si no se encuentra ninguna palabra ofensiva, devuelveFalse.

Luego, el código genera un texto de ejemplo y utiliza la función filter_offensive_content para verificar si el texto contiene contenido ofensivo. Dependiendo del resultado, imprime un mensaje indicando si el texto es seguro o contiene contenido ofensivo.

En resumen, este código verifica si un texto contiene palabras ofensivas y muestra un mensaje indicando si el texto es seguro o no.

La censura en la era digital

Finalmente, la censura siempre ha sido una preocupación en el ámbito de la comunicación. En la era digital, la IAG plantea nuevos desafíos. Por un lado, puede utilizarse para censurar contenidos de forma más eficiente y a gran escala. Por otro lado, la proliferación de información falsa y engañosa puede justificar medidas de censura excesivas. Por consiguiente, es necesario encontrar un equilibrio entre la libertad de expresión y la necesidad de proteger a las personas de la desinformación.

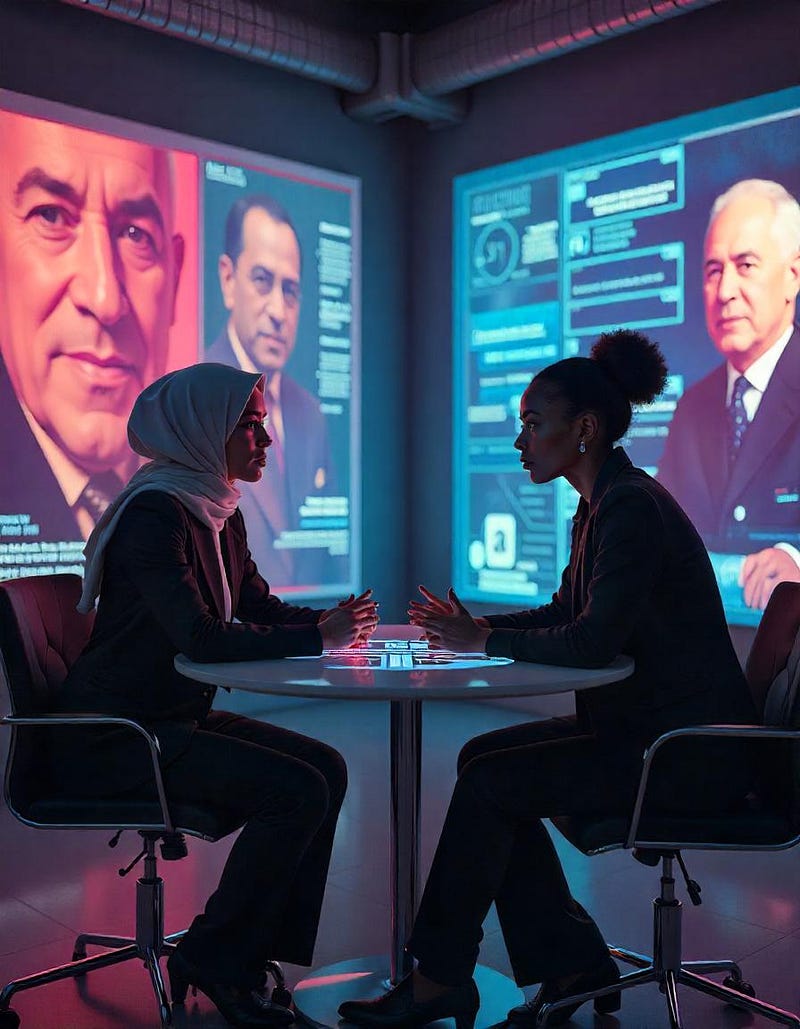

La censura es otro aspecto crítico en la era de la IA generativa. Los gobiernos y las plataformas tecnológicas pueden ejercer control sobre el contenido generado, lo que plantea preguntas sobre la libertad de expresión y el acceso a la información. En otras palabras, puede ser utilizada para proteger a las personas de contenido dañino, pero también puede ser mal utilizada para suprimir voces disidentes y controlar la narrativa.

Un ejemplo de la actualidad viene dado con el caso de DeepSeek, que plantea profundas reflexiones sobre el equilibrio entre el control y la libertad en la era digital. DeepSeek, una IA generativa desarrollada en China, ha sido diseñada para evitar temas sensibles y alinearse con las directrices del gobierno chino. Esto significa que cuando se le pregunta sobre eventos como la masacre de Tiananmén o la situación en Xinjiang, la IA responde con evasivas o cambia de tema.

Por un lado, la censura puede ser vista como una medida para mantener la estabilidad social y proteger la seguridad nacional, como argumentan las autoridades chinas. Sin embargo, también plantea serias preocupaciones sobre la libertad de expresión y el derecho a la información, es decir, la censura puede silenciar voces disidentes y ocultar verdades incómodas, lo que puede llevar a una sociedad menos informada y menos capaz de tomar decisiones basadas en una comprensión completa de los hechos.

Ejemplo de Implementación de censura

def censor_content(text, banned_phrases):

for phrase in banned_phrases:

text = text.replace(phrase, "[CENSURADO]")

return text

# Texto generado

generated_text = "Este es un ejemplo de texto que contiene una frase prohibida."

# Frases prohibidas

banned_phrases = ["frase prohibida"]

# Aplicar censura

censored_text = censor_content(generated_text, banned_phrases)

print(censored_text)Lenguaje del código: PHP (php)Aquí tienes una explicación sencilla de lo que hace este código:

- Definición de la función: La función

censor_contenttoma un texto y una lista de frases prohibidas como entrada. - Reemplazo de frases prohibidas: La función recorre cada frase en la lista de frases prohibidas y la reemplaza en el texto con “[CENSURADO]”.

- Retorno del texto censurado: La función devuelve el texto con las frases prohibidas reemplazadas por “[CENSURADO]”.

Luego, el código genera un texto de ejemplo y aplica la función censor_content para censurar cualquier frase prohibida en el texto. Finalmente, imprime el texto censurado. En resumen, este código reemplaza las frases prohibidas en un texto con “[CENSURADO]” y muestra el texto censurado.

IA Generativa: Un futuro incierto

La IAG es una tecnología con un potencial enorme, pero también plantea riesgos significativos. Es fundamental que tanto la sociedad, los gobiernos y las empresas trabajen juntos para desarrollar un marco ético y regulatorio que garantice un uso responsable de esta tecnología.

La narrativa en la era digital está en constante evolución, y la IA generativa juega un papel central en este proceso. ¿Quién controla la narrativa? La respuesta a esta pregunta depende de cómo manejemos el poder, la ética y la censura en el uso de estas tecnologías avanzadas.

En última instancia, la IA nos obliga a reflexionar sobre el tipo de futuro que queremos construir. ¿Queremos un mundo donde la información esté controlada y filtrada, o donde la libertad de expresión, la ética y el acceso a la información sean valores fundamentales? La respuesta a esta pregunta no solo determinará el desarrollo de la tecnología de IA, sino también el tejido mismo de nuestras sociedades.

Mientras que DeepSeek ha sido elogiada por su eficiencia y bajo costo, su alineación con la censura gubernamental puede socavar la confianza en su imparcialidad y objetividad. Esto puede afectar no solo a los usuarios individuales, sino también a las relaciones internacionales y la cooperación tecnológica.

Finalmente, imaginemos un mundo donde cualquier persona puede crear una realidad alternativa a su antojo. La Inteligencia Artificial Generativa nos está acercando cada vez más a ese escenario. ¿Estamos listos para enfrentar las consecuencias?…